Technologie IBM Quantum

La flotte d'ordinateurs quantiques IBM®, tous dotés d'au moins 127 qubits, est la plus grande au monde. Ces ordinateurs quantiques utilisent des qubits transmon supraconducteurs, qui ne sont pas le seul type de qubit, mais qui présentent de nombreux avantages. En combinant nos ordinateurs quantiques de classe mondiale avec Qiskit, nous permettons à nos utilisateurs d'explorer comment le calcul quantique peut être utile dans le monde d'aujourd'hui. Les partenaires industriels et les chercheurs utilisent la technologie IBM Quantum® pour explorer des calculs significatifs et des applications réalistes. Explorons l'étendue des programmes et des services qu'IBM Quantum offre à ses partenaires.

Si tu fais partie d'une institution membre du réseau IBM Quantum, assure-toi de contacter le groupe de calcul quantique de ton institution pour déterminer à quels avantages tu as accès.

Objectifs d'apprentissage

À la fin de ce module, tu devrais être en mesure de :

- Reconnaître que la résolution de problèmes significatifs impliquera une combinaison de ressources quantiques et classiques.

- Identifier le matériel, les logiciels et les services disponibles pour résoudre des problèmes significatifs.

- Décrire comment mesurer les performances du calcul quantique, notamment l'échelle, la qualité et la vitesse.

IBM Quantum Platform

IBM Quantum Platform fournit une suite d'outils de calcul quantique qui regroupe toutes les ressources de recherche et de développement dont les utilisateurs ont besoin pour accomplir de grandes choses, en un seul endroit. Les utilisateurs peuvent créer un compte et se connecter pour accéder aux ordinateurs quantiques IBM, voir les détails des ordinateurs, suivre les charges de travail et accéder au matériel pédagogique dans la Documentation et l'Apprentissage.

- La page d'accueil sert de point de départ principal pour l'écosystème produit, où les utilisateurs peuvent obtenir leurs clés API, consulter un résumé de leurs instances et informations d'utilisation, voir les détails des emplois récents et accéder à des liens utiles vers d'autres endroits de la plateforme.

- La Documentation regroupe la documentation Qiskit, la documentation du service et les informations de référence API en un seul endroit, organisé de manière à soutenir les flux de travail naturels des utilisateurs.

- L'Apprentissage est le foyer du matériel éducatif, notamment les cours et les modules d'enseignement, ainsi que le Circuit Composer interactif (à venir). Ce combiné d'éditeur graphique et de code permet aux utilisateurs de prototyper, simuler et déboguer des circuits visuellement, puis de les exécuter sur les ordinateurs quantiques IBM.

Qiskit Runtime

Qiskit Runtime est une architecture portative, sécurisée et conteneurisée qui exécute des programmes quantiques sur une unité informatique classique étroitement intégrée au processeur quantique. Qiskit Runtime permet à l'ordinateur quantique de faire partie de tout environnement informatique pour accélérer le calcul — similaire à une unité de traitement graphique (GPU) — et gère l'orchestration des emplois et le transfert de données vers l'unité de traitement quantique, maximisant l'efficacité.

Qiskit et Qiskit Runtime facilitent l'orchestration rapide de programmes sur les ressources de calcul dans le cloud. IBM construit des intergiciels pour le quantique afin de maximiser les performances des applications quantiques s'exécutant sur des ressources de calcul quantiques et classiques parallélisées et basées sur le cloud. Ces intergiciels incluent la boîte à outils de découpe de circuits et notre architecture quantique serverless.

L'addon Qiskit de découpe de circuits permet aux développeurs de découper de grands circuits en circuits plus petits adaptés aux ordinateurs quantiques actuels. La découpe de circuits utilise le calcul classique pour prendre en charge une partie de la charge computationnelle d'un circuit quantique pour dépasser ce qu'on peut réaliser avec l'un ou l'autre seul. Des outils supplémentaires aident à reconstruire les circuits avec des ressources classiques et à assembler les résultats finaux.

Quantum Serverless est une boîte à outils d'orchestration multi-cloud pour connecter des ressources classiques élastiques avec le service Qiskit Runtime d'IBM. Quantum Serverless permet aux développeurs de se concentrer sur le code, plutôt que sur l'approvisionnement des ressources.

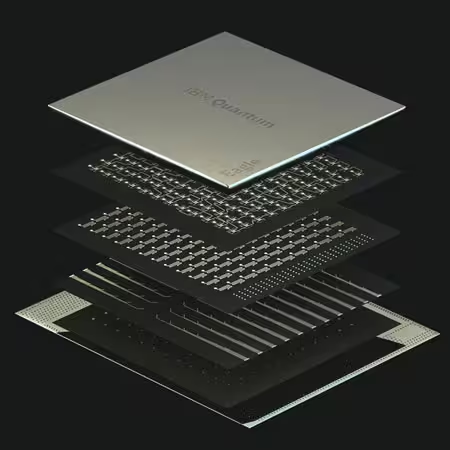

Ordinateurs quantiques supraconducteurs IBM

Les processeurs quantiques IBM utilisent un type physique de qubit appelé qubit transmon supraconducteur, fabriqué à partir de matériaux supraconducteurs modelés sur un substrat de silicium. D'autres processeurs quantiques pourraient utiliser des qubits photoniques, fabriqués à partir de photons individuels de lumière, ou des qubits à ions piégés, qui stockent des informations dans des particules atomiques chargées. Pour faciliter le flux du courant électrique, les qubits supraconducteurs doivent être maintenus à des températures extrêmement basses — proches du zéro absolu.

Processeur IBM à 127 qubits

Performances du calcul quantique

Mesure des performances du calcul quantique

Un ordinateur quantique universel tolérant aux fautes est le grand défi du calcul quantique. C'est un dispositif capable d'effectuer correctement des opérations quantiques universelles à l'aide de composants peu fiables. Les ordinateurs quantiques d'aujourd'hui ne sont pas tolérants aux fautes.

Pour comparer les ordinateurs quantiques entre eux, le nombre de qubits n'est pas suffisant. De nombreux autres détails doivent être pris en compte, comme les taux d'erreur et la façon dont le système est câblé. Il existe quatre métriques clés pour mesurer les performances du calcul quantique :

- Échelle — Mesurée par le nombre de qubits, ce qui indique la quantité d'informations qu'on peut encoder dans l'ordinateur quantique.

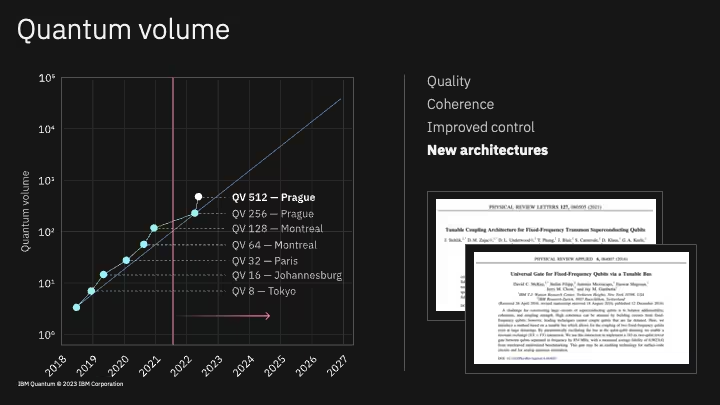

- Qualité — Mesurée par le Volume Quantique, ce qui indique la qualité des circuits et la fidélité avec laquelle les circuits sont implémentés dans le matériel.

- Vitesse — Mesurée par les CLOPS (Circuit Layer Operations Per Second), ce qui indique combien de circuits peuvent être exécutés sur le matériel dans un temps donné.

- Fidélité des couches — Mesurée par l'EPLG (Errors Per Layered Gate), ce qui décrit comment les erreurs se produisent lorsque des opérations sont effectuées sur des qubits.

Pour une description plus détaillée de certaines des métriques ci-dessus, consulte cet article sur le blog IBM Research. Chaque phase dans l'adoption du calcul quantique dans l'industrie est portée par l'augmentation du Volume Quantique, qui est calculé à l'aide de divers paramètres tels que la largeur du circuit, la connectivité des qubits et les taux d'erreur.

La définition technique du Volume Quantique est difficile à communiquer sans équations. Dario Gil, Directeur de la Recherche chez IBM, explique :

Pour mieux comprendre le Volume Quantique, considère l'analogie intéressante suivante. La section ci-dessous couvre le temps, l'espace et les taux d'erreur en termes de visite touristique de New York City.

Visiter les états du Volume Quantique

Le Volume Quantique décrit le plus grand espace de calcul quantique qu'un ordinateur quantique peut explorer, où le volume de l'espace quantique est 2N, avec N étant le nombre de qubits, c'est-à-dire la dimension usuelle de l'espace des états. Nous utilisons intentionnellement le mot « espace » ici car une fois qu'on mentionne l'espace, il est facile de penser à un volume.

Le facteur limitant cette exploration est le taux d'erreur. Le taux d'erreur peut être assimilé à la quantité de temps qu'on est autorisé à explorer l'espace. Plus il y a d'erreurs, moins on a de temps pour explorer. Plus l'espace de calcul est grand, plus il faut de temps pour l'explorer entièrement, et donc on a besoin d'un ordinateur quantique avec un taux d'erreur plus faible.

Imagine un touriste qui explore New York City. Le touriste veut explorer toute la ville, ce qui signifie qu'il veut un volume touristique de la taille de NYC. Si on lui donne seulement un jour, il n'y a aucun moyen d'explorer autant d'espace, donc le touriste n'obtient pas le volume touristique souhaité. Cependant, si on lui donne trois jours, le touriste pourrait probablement visiter tous les meilleurs endroits et obtenir le volume touristique nécessaire de NYC.

Maintenant, que se passe-t-il si on donne plus de temps au touriste mais qu'on restreint quand même l'espace à NYC ? En d'autres termes, que se passe-t-il si on garde le nombre de qubits constant mais qu'on diminue le taux d'erreur ? Il n'y a alors aucun avantage pour le touriste puisqu'il a déjà exploré la ville et ne fait que repasser aux mêmes endroits. Le volume touristique reste le même. Au lieu de cela, avec plus de temps, il est plus intelligent pour le touriste d'augmenter le nombre de sites touristiques à visiter.

Ou supposons qu'on garde le temps fixe à trois jours mais que le touriste décide d'essayer d'explorer toute NYC et Long Island ? En d'autres termes, que se passe-t-il si on fixe le taux d'erreur mais qu'on ajoute plus de qubits ? Encore une fois, le volume touristique reste celui de NYC car le touriste ne peut pas explorer le plus grand espace dans le temps imparti. Ainsi, être un meilleur touriste, et atteindre un plus grand volume touristique, nécessite d'augmenter simultanément l'espace de visite et la quantité de temps que le touriste est autorisé à explorer.

De la même façon, construire de meilleurs ordinateurs quantiques atteignant des Volumes Quantiques plus élevés nécessite d'augmenter simultanément l'espace de calcul quantique (nombre de qubits) tout en diminuant le taux d'erreur (augmentant la durée pendant laquelle l'algorithme peut s'exécuter). Par exemple, grâce aux avancées dans les architectures de couplage ajustable, IBM a doublé le volume quantique deux fois en seulement un an !

Cependant, à mesure que le calcul quantique évolue, on commence à se soucier davantage du travail utile que nos ordinateurs quantiques peuvent accomplir dans un délai raisonnable. Si on mesure l'échelle par le nombre de qubits et la qualité par le volume quantique, alors la vitesse de traitement quantique est la mesure du travail utile que ces qubits peuvent accomplir dans un délai raisonnable. On la définit comme le nombre de circuits primitifs pouvant être traités par seconde. C'est similaire aux FLOPS en informatique classique — le nombre d'opérations en virgule flottante par seconde. Améliorer la vitesse QPU est la clé du calcul quantique pratique. Comme la programmation d'ordinateurs classiques, la programmation quantique nécessite l'exécution de nombreux circuits. Une vitesse QPU raisonnable permettra aux utilisateurs d'intégrer le calcul quantique dans leurs flux de travail.

Vérifie ta compréhension

Lis la question ci-dessous, réfléchis à ta réponse, puis clique sur le triangle pour révéler la solution.

Vrai ou faux : Le Volume Quantique désigne la taille des réfrigérateurs cryogéniques qui abritent les ordinateurs quantiques IBM.

Faux. Le Volume Quantique est un nombre unique destiné à résumer les performances des ordinateurs quantiques d'aujourd'hui.

Quelles sont les prochaines étapes du calcul quantique

Les ordinateurs quantiques d'aujourd'hui, et ceux attendus dans un avenir prévisible, sont bruités. Cela signifie qu'ils sont sensibles aux perturbations environnementales qui peuvent affecter la fidélité des résultats. De la même façon que l'informatique classique a évolué grâce à la mise à l'échelle modulaire des processeurs, à l'efficacité computationnelle et à la parallélisation, nous voyons le calcul quantique évoluer pour réaliser son plein potentiel. Alors que nous travaillons vers des ordinateurs quantiques entièrement tolérants aux fautes, nous voulons résoudre des problèmes utiles avec le matériel et les logiciels que nous possédons aujourd'hui.

Utilité quantique

IBM Quantum et l'Université de Californie, Berkeley ont présenté des preuves que les ordinateurs quantiques peuvent apporter de la valeur plus tôt que prévu grâce aux avancées dans le matériel IBM Quantum et les méthodes d'atténuation des erreurs. Au-delà d'une simple preuve de concept, nous avons livré des résultats suffisamment précis pour être utiles. Le modèle de calcul que nous avons exploré avec ce travail est un aspect central de nombreux algorithmes conçus pour les ordinateurs quantiques à court terme.

La boucle de rétroaction entre le quantique et le classique est essentielle pour faire avancer les technologies quantiques. En se concentrant sur l'utilité quantique, on utilise le quantique pour sonder des problèmes complexes qui défient les frameworks de calcul haute performance existants, puis on vérifie les résultats classiquement. Ce va-et-vient continu entre l'exécution d'un circuit complexe par le quantique et la vérification des résultats quantiques par les ordinateurs classiques améliorera les deux domaines computationnels et donnera aux utilisateurs confiance dans les capacités des ordinateurs quantiques à court terme.

Lecture facultative — cliquez sur le triangle pour en savoir plus sur l'expérience

-

Dans cette expérience, nous avons utilisé les 127 qubits de notre processeur IBM Quantum Eagle pour simuler le comportement changeant d'un système qui se mappe naturellement à un ordinateur quantique, appelé le modèle d'Ising quantique. Les modèles d'Ising sont des simplifications de la nature qui représentent des atomes en interaction comme un réseau de systèmes quantiques à deux choix en interaction dans un champ d'énergie. Ces systèmes ressemblent beaucoup aux qubits à deux états qui composent nos ordinateurs quantiques, ce qui en fait un bon candidat pour tester les capacités de nos méthodes. Nous avons utilisé ZNE pour essayer de calculer avec précision une propriété du système appelée sa valeur d'espérance — essentiellement une moyenne pondérée des résultats possibles du circuit.

-

Simultanément, l'équipe de Berkeley a tenté de simuler le même système en utilisant des méthodes de réseau tensoriel avec l'aide de supercalculateurs avancés situés au National Energy Research Scientific Computing Center (NERSC) du Lawrence Berkeley National Lab et à l'Université Purdue.

-

Les méthodes quantiques ont continué à s'accorder avec les méthodes exactes. Mais finalement, les méthodes d'approximation classiques ont commencé à faillir à mesure que la difficulté augmentait.

-

Finalement, nous avons demandé aux deux ordinateurs d'effectuer des calculs au-delà de ce qui pouvait être calculé exactement — et l'ordinateur quantique a retourné une réponse en laquelle nous avions plus confiance pour être correcte. Et même si nous ne pouvons pas prouver si cette réponse était réellement correcte, le succès d'Eagle sur les exécutions précédentes de l'expérience nous a donné confiance qu'elles l'étaient.

Correction d'erreurs

La correction d'erreurs est un domaine de recherche clé depuis des décennies. Mais pendant la majeure partie de ce temps, les techniques théoriques de correction d'erreurs ont été impraticables à implémenter sur de vrais ordinateurs quantiques, principalement en raison du très grand nombre de qubits nécessaires. En effet, de nombreux experts prédisent que le calcul quantique tolérant aux fautes pratique (FTQC) nécessitera des millions de qubits physiques. Mais dans un récent article publié en couverture de Nature, des chercheurs d'IBM ont introduit un nouveau code, que nous appelons le code Gross, qui surmonte cette limitation.

L'article High-threshold and low-overhead fault-tolerant quantum memory décrit le nouveau code de correction d'erreurs quantiques qui est environ 10 fois plus efficace que les méthodes précédentes pour protéger les données quantiques délicates de l'accumulation d'erreurs. Pour apprécier à quel point on est maintenant plus proche du début de la correction d'erreurs, considère qu'en utilisant le code Gross, tu peux protéger 12 qubits logiques pendant environ un million de cycles de vérifications d'erreurs en utilisant 288 qubits.

On ne s'attend pas à ce que la correction d'erreurs remplace soudainement l'atténuation et la suppression d'erreurs. Au contraire, au cours des prochaines années, l'atténuation et la suppression d'erreurs continueront à jouer un rôle central, aux côtés d'un nombre croissant de qubits corrigés en erreurs.

Feuille de route de développement IBM Quantum

Nous sommes maintenant fermement dans l'ère de l'utilité quantique. Cela signifie que les ordinateurs quantiques sont meilleurs en calcul quantique que les ordinateurs classiques, et peuvent être mis à profit par nos utilisateurs pour découvrir de nouveaux algorithmes et rechercher des avantages quantiques. Notre feuille de route décrit nos jalons historiques et nos plans pour atteindre un avantage quantique à court terme d'ici 2026.

D'ici 2029, nous livrerons Starling — un grand ordinateur quantique tolérant aux fautes capable d'exécuter des circuits quantiques comprenant 100 millions de portes quantiques sur 200 qubits logiques. Nous construisons ce système en ce moment même dans notre installation historique à Poughkeepsie, New York. Apprends-en plus sur notre progression dans le PDF de la feuille de route guidée.

En savoir plus sur la feuille de route de développement IBM Quantum ici.

Le défi 5k

IBM travaille avec la communauté de recherche quantique pour trouver des cas d'usage potentiels qui pourraient bénéficier du calcul quantique. Nous fournissons des outils de plus en plus puissants pour que les utilisateurs puissent explorer des problèmes urgents avec le quantique. En 2024, nous avons sorti un outil capable de calculer des observables non biaisées de circuits longs et de haute qualité. Trouver ce qui peut être fait avec cette combinaison de 100+ qubits et de circuits profonds s'appelait autrefois le « défi 100x100 ». Mais le nombre précis de qubits et la profondeur de chacun importent moins que l'exploitation de la puissance de la combinaison. Imagine ce qui est possible avec 5 000 circuits quantiques dans un seul calcul. Les utilisateurs peuvent exécuter des circuits quantiques avec une complexité et un temps d'exécution au-delà des capacités des meilleurs ordinateurs classiques d'aujourd'hui. Nous sommes impatients de voir ce que la communauté quantique construira pour nous aider à exploiter la puissance du quantique et à résoudre des problèmes importants.

Supercalculateurs centrés sur le quantique

Aller au-delà des processeurs à puce unique est la clé pour résoudre des problèmes à grande échelle. En 2024, nous avons présenté Crossbill, le premier processeur unique fabriqué à partir de plusieurs puces. Ce sont les premières étapes pour inaugurer une nouvelle ère de mise à l'échelle, offrant un chemin clair vers 100 000 qubits et au-delà avec la supercalculation centrée sur le quantique. C'est une architecture informatique modulaire qui permet la mise à l'échelle. Elle combine la communication et le calcul quantiques pour augmenter la capacité computationnelle, tout en employant des intergiciels cloud hybrides pour intégrer de manière transparente les flux de travail quantiques et classiques.

La résolution des problèmes les plus complexes du monde nécessitera une combinaison de ressources classiques et quantiques. De plus, cela dépendra de la collaboration continue entre l'industrie et le monde académique.

Points clés à retenir

Tu peux garder ces points clés à l'esprit :

- Les ordinateurs quantiques d'aujourd'hui ne sont pas tolérants aux fautes.

- Le Volume Quantique est une mesure holistique de la qualité d'un ordinateur quantique. Plus le Volume Quantique est élevé, mieux c'est. Parler uniquement du nombre de qubits est trompeur.

- Pour mesurer les performances des ordinateurs quantiques, il existe quatre métriques clés : l'échelle, la qualité, la vitesse et la fidélité des couches.

- Une expérience conjointe IBM Quantum-UC Berkeley a présenté des preuves que les ordinateurs quantiques IBM fournissent des résultats fiables et précis pour des problèmes de simulation difficiles à l'échelle de 127 qubits.

- La supercalculation centrée sur le quantique signifie traiter le quantique comme une pièce d'un paradigme HPC plus large avec le classique et le quantique fonctionnant comme une seule unité computationnelle.