Le contexte de l'informatique quantique

Dans la vidéo suivante, Olivia Lanes te guide à travers le contenu de cette leçon. Tu peux aussi ouvrir la vidéo YouTube de cette leçon dans une fenêtre séparée.

Tu as commencé ce cours en plongeant directement dans l'exécution de ton premier circuit quantique, et en apprenant comment les lois de la mécanique quantique sont utilisées pour créer des états quantiques, des gates et des circuits. Maintenant, prenons un peu de recul. Dans cette section, nous allons explorer l'informatique quantique à travers différents prismes qui t'aideront à aborder les conversations, les titres d'actualité et les articles sur l'informatique quantique avec un regard plus critique.

Il ne fait aucun doute qu'il y a beaucoup d'enthousiasme autour de l'informatique quantique et des possibilités que cette technologie pourrait offrir. On pourrait même aller jusqu'à parler de « hype ». Comme c'est toujours le cas lorsqu'il y a du hype autour d'une nouvelle découverte, il peut être difficile de distinguer le vrai du faux. Dans cet esprit, il vaut mieux commencer par ce que l'informatique quantique n'est pas :

- L'informatique quantique ne va pas remplacer les ordinateurs traditionnels classiques — ni finir dans un « téléphone quantique »

- Ce n'est pas un moyen de « vérifier simultanément toutes les réponses possibles en même temps »

- Elle n'est pas universellement meilleure que les ordinateurs classiques pour toutes les tâches

- Elle n'est pas en guerre avec l'IA

- Elle n'est pas inutile jusqu'à ce que nous atteignions la tolérance aux pannes ou la correction d'erreurs

- Ce n'est pas de la magie

Espérons que cela ne t'a pas éloigné de ce cours ou ne t'a pas fait penser qu'il n'y a rien de valeur ici. Bien au contraire ! L'informatique quantique a le potentiel d'être immensément puissante — mais uniquement pour certaines applications. Heureusement, ces applications incluent des domaines de recherche active qui pourraient transformer fondamentalement la façon dont nous abordons des problèmes importants, comme les simulations chimiques, l'exploration des matériaux et l'analyse de grands ensembles de données. Avant d'explorer ces domaines d'application, creusons d'abord ces idées reçues plus en détail.

Mise à l'échelle

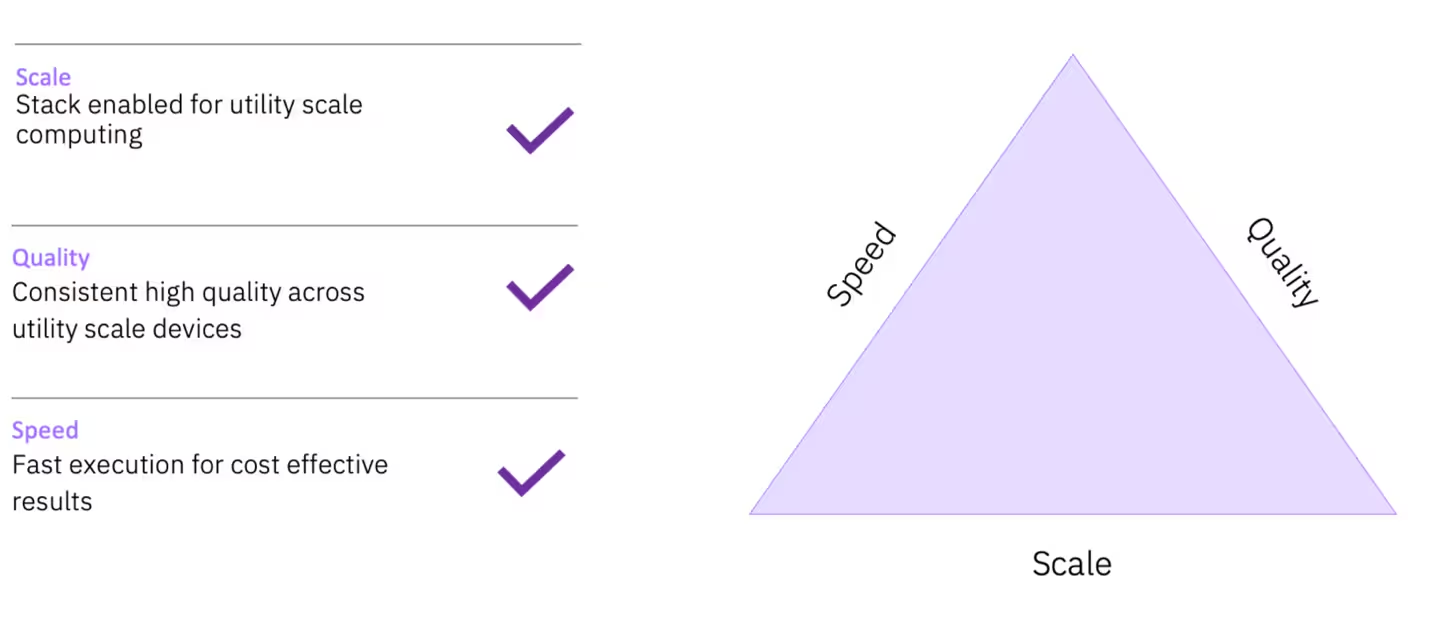

Une autre idée reçue courante concernant les ordinateurs quantiques est que plus ils ont de qubits, plus ils sont puissants. Bien que ce ne soit pas nécessairement faux, cela ne donne pas l'image complète. Bien que l'augmentation de la quantité soit certainement un élément crucial, elle n'est pas plus importante que la qualité des qubits eux-mêmes. La qualité est mesurée de plusieurs façons, l'une des plus importantes étant les temps de cohérence et de déphasage, ou et , respectivement. Ce sont des mesures de la durée pendant laquelle l'information quantique dans un qubit peut rester stable. Lorsque les premiers qubits supraconducteurs ont été démontrés, ce nombre était de l'ordre de la nanoseconde (Nakamura et al., 1999) ; maintenant, nous produisons régulièrement des qubits avec des temps de cohérence stables de centaines de microsecondes.

Un autre composant critique sur lequel nous nous appuyons pour voir comment les ordinateurs quantiques s'améliorent est la vitesse. Pour mesurer la vitesse, nous utilisons quelque chose appelé Circuit Layer Operations Per Second (CLOPS). Les CLOPS intègrent à la fois le temps d'exécution d'un circuit ainsi que le calcul classique en temps réel et quasi-réel, lui permettant de servir de mesure unique et globale de la vitesse.

Ces trois éléments ensemble sont nécessaires pour continuer à construire le chemin vers un ordinateur quantique universel tolérant aux pannes. C'est pourquoi, en regardant la feuille de route d'IBM Quantum®, tu remarqueras que certains sauts entre processeurs n'ont pas d'énormes augmentations du nombre de qubits. Par exemple, remarque l'augmentation modeste du nombre de qubits entre Heron et Nighthawk, car ce n'est pas le vrai objectif de cette amélioration. À la place, Nighthawk implémente une nouvelle topologie de connectivité qui permettra différents codes de correction d'erreurs.

Correction d'erreurs versus atténuation des erreurs

La correction d'erreurs reste l'un des plus grands objectifs à long terme pour les chercheurs en informatique quantique. Elle repose sur le principe que les qubits resteront toujours quelque peu bruyants et sujets aux erreurs, et si nous voulons exécuter des algorithmes à grande échelle, comme celui de Shor par exemple, nous aurons besoin de la capacité à détecter et corriger ces erreurs en temps réel. Il existe de nombreux types de codes correcteurs d'erreurs, et nous te renvoyons à d'autres cours (comme le cours Foundations of quantum error correction) si tu veux approfondir le sujet.

L'atténuation des erreurs, en revanche, est déjà utilisée régulièrement pour améliorer les résultats de l'informatique quantique. L'idée derrière l'atténuation des erreurs est que nous acceptons que des erreurs se produiront, et nous essayons de prédire leur comportement pour réduire leurs effets. Il existe de nombreuses techniques d'atténuation des erreurs ; beaucoup nécessitent plusieurs exécutions sur un ordinateur quantique plus un post-traitement classique. Il est peu probable que la correction d'erreurs remplace complètement l'atténuation des erreurs. À la place, nous prédisons que les deux seront utilisées ensemble pour retourner les meilleurs résultats possibles des ordinateurs quantiques.

Composants de l'informatique quantique

Précédemment, nous avons mentionné que c'est une idée reçue courante que les ordinateurs quantiques remplaceront un jour les ordinateurs classiques. Ce n'est absolument pas le cas ; les ordinateurs quantiques et les ordinateurs classiques ne sont pas vraiment en guerre pour se remplacer mutuellement. En fait, comme noté dans la section précédente, les ordinateurs quantiques ont besoin des ordinateurs classiques pour fonctionner, pour diverses raisons. Lorsque nous parlons d'« ordinateurs » de façon générale, nous supposons généralement qu'ils incluent tous les composants comme un CPU, de la RAM, de la mémoire, etc. À l'inverse, un ordinateur quantique n'a pas tous ces composants. Souvent, lorsque les gens parlent d'un ordinateur quantique, ils font en réalité référence au QPU, ou Quantum Processing Unit, qui prend en charge le rôle de traitement du CPU. Le QPU lui-même n'est pas un ordinateur à usage général. Il n'exécute pas de système d'exploitation, ne gère pas la mémoire ni les interfaces utilisateur. Son seul rôle est de manipuler les qubits selon des opérations quantiques soigneusement contrôlées avant de renvoyer les résultats de mesure à un système classique.

En pratique, les ordinateurs quantiques d'aujourd'hui sont mieux compris comme des systèmes hybrides. Un ordinateur classique orchestre le workflow — préparant les entrées, compilant les circuits quantiques, planifiant les jobs et post-traitant les résultats — tandis que le QPU n'exécute que la partie quantique du calcul. Même à mesure que le matériel quantique progresse, cette division du travail devrait persister, les progrès se concentrant sur une intégration plus étroite et une communication plus rapide entre les systèmes classiques et les QPU plutôt que d'éliminer entièrement les composants classiques.

Domaines d'application probables de l'informatique quantique

Nous regroupons largement les domaines où nous pensons que l'informatique quantique aura le plus d'impact en quatre catégories : l'optimisation, la simulation hamiltonienne, les équations aux dérivées partielles (EDP) et l'apprentissage automatique.

Simulation hamiltonienne

Ce sujet concerne la simulation de processus quantiques mécaniques trouvés dans la nature. En son cœur, il implique deux grandes tâches : trouver l'énergie de l'état fondamental d'un système décrit par son Hamiltonien, qui encode l'énergie totale et les interactions au sein du système, et simuler comment ce système évolue dans le temps (dynamique quantique).

C'est l'un des domaines d'application les plus naturels pour les ordinateurs quantiques : les systèmes quantiques sont notoirement difficiles à simuler sur des ordinateurs classiques, car la taille de l'espace d'états quantiques croît de façon exponentielle avec le nombre de particules. Les ordinateurs quantiques, en revanche, représentent les états quantiques directement, ce qui les rend bien adaptés — du moins en principe — à ces types de problèmes.

Les principaux domaines d'application incluent :

- Chimie et science des matériaux : prédiction de la structure moléculaire, des voies de réaction, des énergies de liaison et des propriétés des matériaux

- Physique de la matière condensée : étude des systèmes fortement corrélés, des transitions de phase et des états quantiques exotiques

- Physique des hautes énergies et physique nucléaire : modélisation des interactions entre particules

À long terme, les avancées dans la simulation hamiltonienne pourraient permettre :

- Une découverte de médicaments et une conception de catalyseurs plus précises

- La découverte de nouveaux matériaux pour les batteries

- Une compréhension plus profonde des phénomènes physiques fondamentaux

Beaucoup des algorithmes quantiques les plus étudiés, comme SQD, ont été développés spécifiquement en pensant à la simulation hamiltonienne. Par conséquent, cette catégorie est souvent considérée comme l'un des cas d'utilisation les plus scientifiquement convaincants et théoriquement fondés pour l'informatique quantique.

Optimisation

Les problèmes d'optimisation consistent à trouver la meilleure solution parmi un grand ensemble de solutions possibles, sous contraintes. Ces problèmes apparaissent dans la science, l'ingénierie et l'industrie, et deviennent souvent insolubles computationnellement à mesure que la taille du problème augmente.

Les exemples incluent :

- Planification et routage (par exemple, chaînes d'approvisionnement, flux de trafic, planification des compagnies aériennes)

- Optimisation de portefeuille et gestion des risques (finance)

- Allocation des ressources et logistique

- Problèmes combinatoires tels que la partition de graphes et la coupe maximale

Beaucoup de problèmes d'optimisation sont catégorisés comme NP-difficiles en théorie de la complexité, ce qui signifie que les algorithmes classiques s'appuient généralement sur des heuristiques ou des approximations pour les grandes instances. Parce que les qubits se comportent différemment des bits classiques, nous pouvons modéliser les solutions différemment. Cela pourrait nous permettre d'explorer les espaces de solutions plus rapidement ou plus complètement que les algorithmes classiques.

Les approches quantiques courantes comprennent :

- Les algorithmes variationnels, comme le Quantum Approximate Optimization Algorithm (QAOA)

- Les workflows hybrides classique-quantique, où les solveurs classiques guident et affinent les sous-routines quantiques

Bien que ce soit encore une question ouverte de savoir quand — ou pour quels problèmes — l'optimisation quantique fournira un avantage clair sur les méthodes classiques de pointe, l'optimisation reste un domaine d'intérêt majeur en raison de son omniprésence et du mapping naturel entre les objectifs d'optimisation et les Hamiltoniens quantiques.

Équations aux dérivées partielles (EDP)

Les équations aux dérivées partielles décrivent comment les grandeurs physiques changent dans l'espace et le temps. Elles sous-tendent beaucoup des modèles les plus importants en science et en ingénierie, notamment la dynamique des fluides, l'électromagnétisme, le transfert de chaleur et la modélisation financière.

Les exemples incluent :

- Les équations de Navier-Stokes pour l'écoulement des fluides

- Les équations de Schrödinger et les équations d'ondes

- Les équations de Maxwell

- Black-Scholes et les EDP financières associées

La résolution numérique des EDP sur des ordinateurs classiques nécessite souvent des grilles spatiales fines et de longues évolutions temporelles, entraînant des coûts de calcul et d'utilisation de la mémoire élevés.

Les algorithmes quantiques pour les EDP s'appuient généralement sur ce qui suit :

- Le mapping des EDP vers de grands systèmes d'équations linéaires

- Les sous-routines d'algèbre linéaire quantique, comme l'algorithme HHL et ses variantes

- Les workflows hybrides où le pré-traitement et le post-traitement classiques entourent les noyaux quantiques

En théorie, certaines approches quantiques peuvent offrir des accélérations exponentielles ou polynomiales sous des hypothèses spécifiques (comme une préparation et une lecture d'état efficaces). En pratique, la résolution des EDP devrait être une application à plus long terme, étroitement liée aux progrès de l'informatique quantique tolérante aux pannes et de l'intégration quantique-classique avec les systèmes de calcul haute performance (HPC).

Apprentissage automatique

L'apprentissage automatique quantique (QML) explore comment les ordinateurs quantiques pourraient améliorer ou accélérer des aspects de l'apprentissage automatique et de l'analyse de données. Cela inclut les deux aspects suivants :

- Utiliser des ordinateurs quantiques pour explorer des problèmes de classification avec un comportement de classification différent des algorithmes classiques

- Développer de nouveaux modèles qui sont intrinsèquement quantiques par nature

Les applications proposées incluent :

- Classification et clustering

- Méthodes à noyaux et cartes de caractéristiques

- Sous-routines d'optimisation dans les boucles d'entraînement

Beaucoup d'algorithmes QML exploitent les éléments suivants :

- Les circuits quantiques paramétrés comme modèles entraînables

- Les techniques d'optimisation variationnelle

- Les noyaux quantiques qui opèrent implicitement dans des espaces de caractéristiques de haute dimension

Cependant, l'apprentissage automatique est un domaine particulièrement difficile pour l'avantage quantique. L'apprentissage automatique classique est extrêmement mature, et les modèles quantiques doivent faire face à des problèmes tels que le chargement des données, le bruit et la mise à l'échelle.

Par conséquent, la recherche actuelle se concentre sur ces domaines :

- Identifier des régimes spécifiques où les modèles quantiques pourraient surpasser les modèles classiques

- Explorer le QML comme partie de workflows hybrides plutôt que comme remplacement autonome

- Comprendre l'expressivité, l'entraînabilité et la généralisation des modèles quantiques

L'apprentissage automatique quantique reste un domaine de recherche actif, avec un impact potentiel à long terme — mais aussi des questions ouvertes significatives sur quand et où un avantage pratique émergera.

Conclusion

Cette leçon a clairement montré que l'avantage quantique ne consiste pas à remplacer les ordinateurs. Il s'agit d'élargir ce qui est calculable. C'est l'un des projets d'ingénierie les plus ambitieux que l'humanité ait jamais tentés. Et comme tous les projets ambitieux, c'est désordonné, lent, et assez incroyable.

Si tu veux un suivi sur le fonctionnement réel de ces algorithmes, la prochaine leçon te montrera où aller à partir d'ici selon tes intérêts et tes objectifs de carrière.