Quels problèmes les ordinateurs quantiques sont-ils bons à résoudre ?

Regarde la vidéo sur les applications du calcul quantique par Olivia Lanes, ou ouvre la vidéo dans une fenêtre séparée sur YouTube.

Introduction

Dans la leçon précédente, nous avons traité un problème en profondeur — résoudre le problème d'optimisation Max-Cut en utilisant la formulation QUBO. Aujourd'hui, nous allons adopter une approche différente et discuter des applications à court terme de façon plus générale. Nous commencerons par te donner une idée de la façon dont nous déterminons les types de problèmes susceptibles de bénéficier d'une solution quantique. Ensuite, nous examinerons quelques exemples récents de travaux réalisés dans notre communauté. Cela t'aidera à développer une intuition pour les différents types de problèmes de calcul quantique et la façon dont nous abordons leur résolution.

Difficulté classique vs. quantique

Avant de plonger dans les exemples, discutons d'abord de la façon dont nous étudions et classons la difficulté de divers problèmes. Certains problèmes peuvent facilement être résolus sur un ordinateur classique, et nous n'avons pas besoin d'un ordinateur quantique pour les résoudre. D'un autre côté, il existe des problèmes très difficiles pour lesquels les ordinateurs quantiques sont nécessaires. Un exemple célèbre est la recherche des facteurs premiers d'entiers énormes. Le chiffrement RSA repose sur la difficulté de ce problème, et l'algorithme de Shor a été conçu pour le résoudre sur un ordinateur quantique. Un autre exemple est la recherche d'une solution dans un ensemble de données non trié — cela peut théoriquement être résolu par l'algorithme quantique connu sous le nom d'algorithme de Grover. Cependant, la plupart des experts s'accordent à dire que ces types d'algorithmes nécessiteront la mise en œuvre de la correction d'erreurs et que la technologie n'est pas encore là.

Nous cherchons donc des problèmes qui se situent quelque part dans une zone idéale entre le très facile et le très difficile — des problèmes que les ordinateurs quantiques d'aujourd'hui peuvent aborder, mais que les ordinateurs classiques ont du mal à résoudre.

Classes de complexité

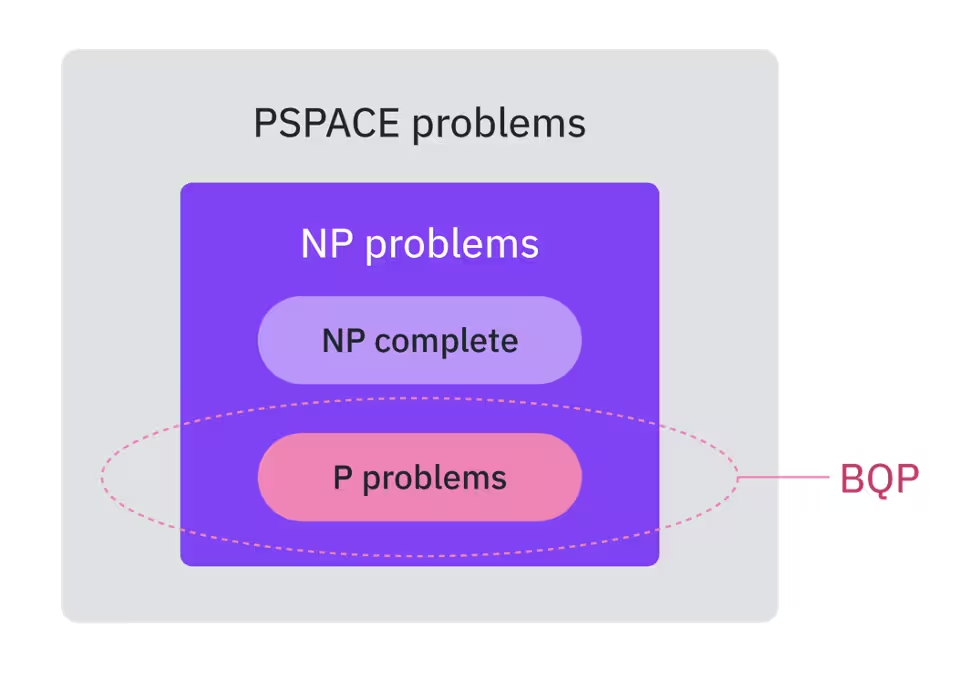

La difficulté de ces problèmes est catégorisée et analysée dans une branche de l'informatique appelée théorie de la complexité computationnelle. Il existe de nombreuses classes de complexité différentes en informatique classique, mais certaines des plus fondamentales sont :

- P : Problèmes pouvant être résolus en temps polynomial à mesure que l'échelle du problème augmente. Ils sont faciles à résoudre.

- NP : Cela signifie polynomial non déterministe. Ces problèmes ne peuvent pas nécessairement être résolus en temps polynomial, mais leurs réponses peuvent être vérifiées en temps polynomial.

- NP-complet regroupe les problèmes les plus difficiles dans NP et n'a pas de solution polynomiale connue. C'est là que vivent des problèmes célèbres comme le voyageur de commerce et le jeu Sudoku.

- BPP, ou problèmes polynomiaux à erreur bornée, qui peuvent être résolus avec un certain seuil d'erreur par un ordinateur classique probabiliste en temps polynomial.

Lorsque le concept du calcul quantique a été inventé, les chercheurs ont consacré des efforts considérables à déterminer quelle classe de problèmes ces nouveaux types d'ordinateurs pourraient résoudre efficacement. Une nouvelle classe de problèmes a été inventée :

- BQP, ou problèmes polynomiaux quantiques à erreur bornée. C'est l'équivalent quantique de BPP : c'est la classe des problèmes de décision solubles par un ordinateur quantique en temps polynomial avec une faible probabilité d'erreur.

Toutes ces classes vivent dans une classe plus grande que nous appelons PSPACE. Ci-dessus se trouve un diagramme des relations supposées entre certaines des classes de complexité, mais il est très difficile de le prouver mathématiquement de façon définitive. Tu remarqueras que BQP ne chevauche pas nécessairement NP-complet. Mais tu as peut-être quand même vu des approches du calcul quantique qui visent à résoudre des problèmes dans NP-complet.

Une idée reçue courante est qu'il n'y a aucun intérêt à explorer des solutions quantiques pour des problèmes où une preuve mathématique d'accélération quantique n'a pas été trouvée. Mais une preuve mathématique qu'un algorithme quantique est plus rapide que son homologue classique est difficile à trouver. Shor et Grover sont deux des rares exemples où cela a été fait jusqu'à présent. En fait, prouver rigoureusement que P et NP sont différents est l'une des questions ouvertes les plus notoires de toutes les mathématiques, même si toute l'intuition nous dit qu'ils doivent l'être.

Mais la façon dont un algorithme évolue avec l'augmentation de la taille du problème — ce qui est reflété dans la classe de complexité — n'est pas toujours la caractéristique la plus pertinente d'un algorithme. Cette mise à l'échelle est souvent le scénario dans le pire des cas. Il est tout à fait possible qu'en pratique, le pire des cas ne soit pas ce que nous rencontrons le plus couramment.

Juste parce que les preuves de difficulté sont complexes ne signifie pas que nous ne pouvons pas progresser. Nous introduisons l'idée de solutions heuristiques. Si tu es un expérimentateur, tu connais et aimes probablement ces types de solutions. Une heuristique est toute approche pour résoudre un problème qui est pragmatique, mais pas nécessairement optimale, car les solutions n'ont pas besoin d'être optimales pour être utiles. Par exemple, pense aux applications financières. Nous n'avons pas encore trouvé d'accélération exponentielle pour la plupart des algorithmes financiers pour lesquels le quantique pourrait être utilisé, mais nous n'avons pas besoin d'une solution optimale. En finance, même une solution qui est juste 0,1 % plus efficace pourrait équivaloir à des milliards de dollars de profit.

Les ordinateurs quantiques d'aujourd'hui et leurs limites

Alors, comment savons-nous quels cas d'usage et problèmes pourraient convenir au calcul quantique en ce moment ? Y a-t-il une bonne raison de croire que l'utilité quantique, voire l'avantage, peut être trouvé maintenant ou dans un avenir proche ?

Il est peut-être plus facile de nommer d'abord les choses que le problème ne devrait certainement pas avoir. Il ne peut pas nécessiter un grand nombre de qubits. Nous n'avons pas encore de processeurs avec des milliers ou millions de qubits disponibles. C'est l'une des principales raisons pour lesquelles l'algorithme de Shor et ses semblables sont si loin d'être réalisés. Les circuits ne peuvent pas non plus être trop profonds. La limite de profondeur de circuit dépend de nombreux facteurs, mais en général, si ton expérience nécessite une profondeur que tu n'as pas encore vue atteinte dans la littérature, cela ne fonctionnera probablement pas. Et enfin, tout type d'algorithme dont nous savons qu'il nécessitera une correction d'erreurs ne peut pas encore être réalisé.

Toutes ces limitations sont abordées dans la feuille de route IBM Quantum® et nous espérons atteindre la correction d'erreurs au début des années 2030, mais pour l'instant, nous devons chercher des expériences qui utilisent la plupart des qubits actuellement disponibles sur un QPU donné. Nous soulignons également l'importance de l'atténuation et de la suppression des erreurs. Et enfin, il devrait y avoir une extension évidente vers des applications futures qui seraient importantes pour la société et qui pourraient éventuellement conduire à un avantage quantique.

Domaines d'application et cas d'usage

Parlons maintenant de quelques exemples de cas d'usage, qui se répartissent en trois catégories principales que nous avons identifiées comme les plus susceptibles de voir des résultats favorables à court et moyen terme :

-

Simulations de la nature. Les méthodes classiques actuelles de simulations atomiques et moléculaires sont limitées par des descriptions mathématiques inefficaces de la structure atomique. Stocker et manipuler un état quantique prend exponentiellement beaucoup de ressources sur un ordinateur classique, mais peut être fait efficacement sur un ordinateur quantique. Cela pourrait conduire à des développements dans la séquestration du dioxyde de carbone, les batteries alternatives, ou l'invention de nouveaux médicaments. Parmi les algorithmes particulièrement pertinents dans ce domaine : le Variational Quantum Eigensolver (VQE), utilisé pour estimer certaines propriétés d'un matériau, comme l'équilibre ou les états d'énergie minimale ; l'algorithme de Simulation de Dynamique Temporelle (TDS), utilisé pour estimer les fonctions de réponse ou les propriétés spectrales des matériaux ; et un nouveau venu, la Diagonalisation Quantique par Échantillonnage (SQD), dont nous pensons qu'on entendra beaucoup parler dans un avenir proche.

-

Optimisation. Ce domaine est omniprésent en informatique, donc les cas d'usage sont nombreux et variés. Quelques exemples qu'on entend souvent sont l'optimisation de portefeuille en finance, la conception industrielle, et la distribution et la chaîne d'approvisionnement. L'algorithme le plus courant qu'on entend souvent en rapport avec la finance est celui que nous avons déjà couvert en profondeur : l'algorithme d'optimisation approximative quantique, ou QAOA.

-

Apprentissage automatique quantique. Ce domaine a suscité beaucoup d'enthousiasme ces dernières années, mais il est probable que le QML ne sera pas utile aussi tôt que la simulation. Mais il existe néanmoins quelques algorithmes impressionnants qui sont en cours de développement pour répondre à des cas d'usage très importants. Certains de ces cas d'usage possibles sont le traitement du langage naturel, l'analyse du trafic réseau, et même la détection de fraude dans les transactions financières. Les algorithmes pertinents dans ce domaine sont la machine à vecteurs de support quantique (QSVM), les réseaux de neurones quantiques (QNN) et les réseaux antagonistes génératifs quantiques.

Au sein de ces larges domaines d'application, la communauté voit l'intérêt de groupes travaillant ensemble sur un sujet plus spécifique. IBM® a lancé une initiative appelée Groupes de Travail pour aider les collaborateurs à se rencontrer et à créer une synergie productive dans quatre domaines spécifiques : santé et sciences de la vie, matériaux et calcul haute performance (HPC), physique des hautes énergies, et optimisation. Et récemment, un cinquième groupe de travail sur la durabilité a été créé.

Nous allons maintenant nous concentrer sur quelques problèmes récemment abordés par certains de ces groupes de travail. L'objectif principal ici n'est pas de comprendre chaque détail d'une expérience — cela peut être intimidant même pour les experts si l'article est légèrement en dehors de leur domaine d'expertise. L'objectif est simplement d'aider à développer une intuition pour les types de problèmes pour lesquels les ordinateurs quantiques sont bons et comment les aborder. Et si tu es intéressé, nous t'encourageons à lire les articles complets.

Cas d'usage 1 : Simuler la dynamique des hadrons

Premièrement, nous allons explorer un article du groupe de Martin Savage à l'Université de Washington intitulé Quantum Simulations of Hadron Dynamics in the Schwinger Model Using 112 Qubits.

Si tu n'es pas physicien des hautes énergies, tu es peut-être quand même familier avec le terme « hadron », comme dans le Grand Collisionneur de Hadrons (LHC), le gigantesque accélérateur de particules de 27 km de circonférence qui a permis d'observer finalement le boson de Higgs. Un hadron est une particule composite subatomique composée d'autres petites particules appelées quarks. Parmi les exemples de hadrons, on trouve les neutrons et les protons.

Pour donner un peu de contexte, le LHC a été construit pour permettre l'étude de la physique fondamentale en faisant entrer des particules en collision à des énergies très élevées. Avec le LHC, les scientifiques espèrent en apprendre davantage sur l'univers primitif et les lois fondamentales de la nature. En principe, les interactions de ces particules pourraient être simulées du début à la fin avec un ordinateur quantique suffisamment puissant. Nous n'en sommes pas encore là, mais nous progressons.

Le modèle de Schwinger est un modèle simple et populaire utilisé pour simuler certaines de ces dynamiques. C'est un modèle qui décrit le comportement des électrons et des positrons interagissant via des photons en 1+1D, c'est-à-dire le temps et une dimension spatiale. Le modèle présente beaucoup de similitudes avec la chromodynamique quantique (QCD), qui décrit comment les quarks et les hadrons interagissent, mais la QCD est extrêmement difficile à simuler. Le modèle de Schwinger est donc souvent utilisé comme modèle jouet pour étudier certains phénomènes communs aux deux.

Pour comprendre pourquoi ils ont abordé ce problème, posons-nous une série de questions.

Premièrement, pourquoi avaient-ils des raisons de croire que la simulation sur un ordinateur quantique fonctionnerait ? Dans ce cas, les électrons et les positrons du modèle de Schwinger ont un effet d'écran, provoquant une décroissance exponentielle des corrélations entre les fermions distants avec la séparation. Cela signifie qu'il n'y a pas autant d'interactions longue portée nécessaires entre un qubit d'un côté de la puce et un autre, ce qui est très sujet aux erreurs. C'est donc idéal pour le matériel disponible aujourd'hui.

Ensuite, pourquoi ce sujet est-il d'intérêt ? La physique des hautes énergies en général est d'un grand intérêt. Les gens étaient prêts à dépenser des milliards de dollars pour construire le LHC, et des milliers de scientifiques et techniciens à travers le globe ont consacré leur carrière à ce domaine. Bien que le modèle de Schwinger soit simpliste et ne soit pas conçu pour couvrir trois dimensions spatiales, il reste une simplification utile de la théorie complète.

Enfin, comment ce travail a-t-il été réalisé, ou comment aborderions-nous le problème si nous cherchions à continuer ce travail ? Dans les expériences de type simulation, VQE est l'une des approches les plus courantes, et la première étape est presque toujours la même : préparer l'état fondamental. Dans ce cas, c'est un état de vide. Dans cette expérience, ils utilisent une nouvelle version de VQE appelée SC-ADAPT-VQE (qui signifie Circuits Évolutifs - VQE adaptatif pseudo-Trotter assemblé par dérivée) pour préparer à la fois l'état fondamental et le paquet d'ondes de hadrons sur ce vide. L'étape suivante est de laisser les hadrons évoluer dans le temps. Enfin, identifier les observables qu'on veut mesurer et les mesurer.

Si ces étapes semblent quelque peu familières, à l'exception de la partie paquet d'ondes de hadrons, c'est parce que ces étapes sont très similaires à ce que nous avons couvert dans l'exemple QAOA lors de la leçon précédente. On part d'un état familier (ici l'état de vide), puis on le laisse évoluer dans le temps avec une série d'hamiltoniens exponentiés. De nombreux algorithmes variationnels suivent cette approche générale. Une grande différence ici, cependant, est que nous créons le paquet d'ondes de hadrons centré dans notre circuit, avant de commencer à le laisser évoluer.

Comment créer le paquet d'ondes ? Sur le vide, un hadron peut être excité en créant une paire fermion-antifermion sur des sites adjacents. En préparant une superposition de tels hadrons à différents emplacements, un paquet d'ondes arbitraire peut être préparé. Les auteurs ont centré leur paquet d'ondes au milieu du circuit pour observer l'évolution sans atteindre une frontière.

Mais rappelons : l'enjeu lorsqu'on travaille avec des QPU bruités est de maintenir la profondeur du circuit gérable. Pour ce faire, le protocole SC-ADAPT-VQE utilise les symétries et les hiérarchies d'échelles de longueur pour déterminer des circuits quantiques de faible profondeur pour la préparation des états. Cela créera un ansatz avec un plus petit nombre de paramètres, et donc une profondeur plus faible.

L'expérience a été réalisée sur un dispositif IBM Quantum Heron et a inclus quelques types différents d'atténuation et de suppression des erreurs : le découplage dynamique, l'extrapolation à bruit zéro, le brassage de Pauli, et une technique récemment développée appelée renormalisation de la décohérence des opérateurs.

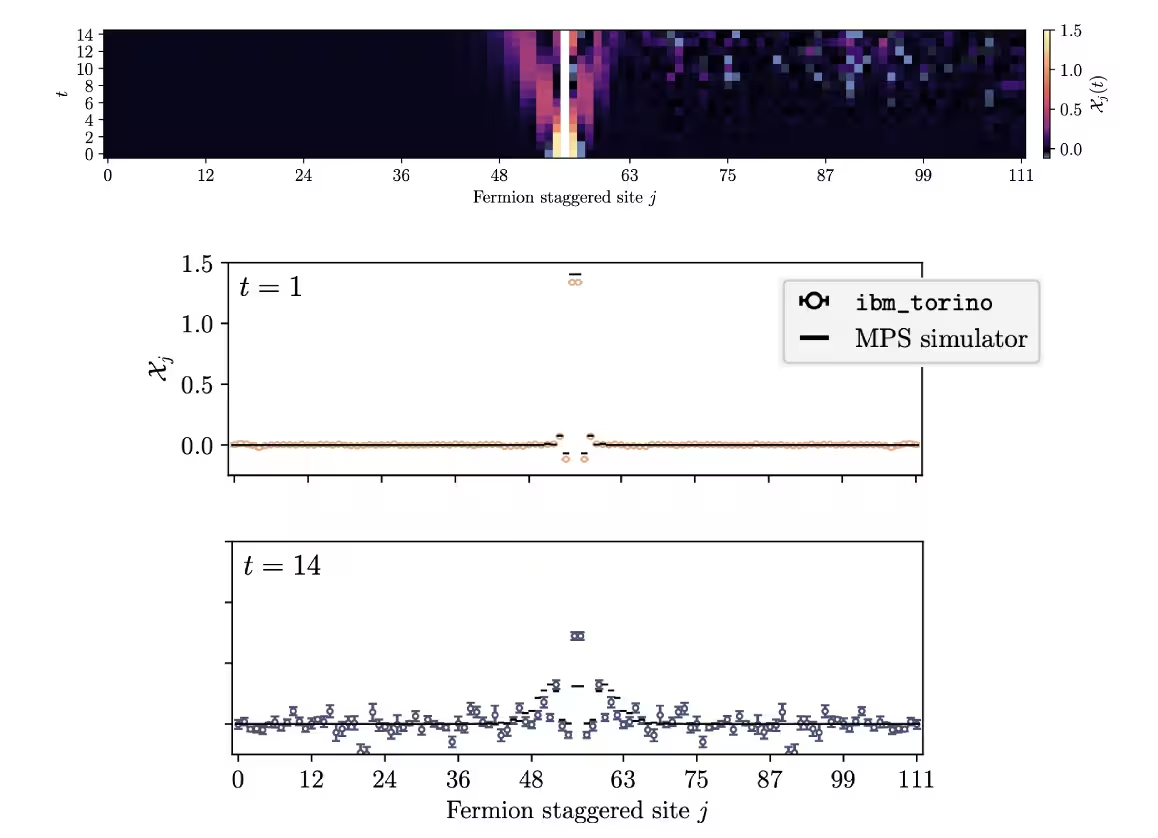

Ci-dessus se trouve une figure tirée de l'article montrant l'observable d'intérêt, le condensat chiral, qui est essentiellement une phase superfluide des hadrons. On peut voir le paquet d'ondes au centre des sites désignés pour cette expérience. Les lignes noires sont les résultats sans erreur de la simulation classique (coûteuse en calcul), tandis que les points avec barres d'erreur sont les résultats de l'ordinateur quantique IBM de 133 qubits, Torino.

On voit deux pas de temps différents dans l'évolution du paquet d'ondes. Au temps , on peut voir que le condensat chiral est étroit et localisé, et qu'il correspond aussi bien à la simulation classique. À , il est beaucoup plus étalé. La comparaison avec le simulateur n'est pas tout à fait aussi parfaite maintenant, mais on peut encore voir un très bon accord entre théorie et données, ce qui est encourageant.

En conclusion, c'est un très bel exemple du type de travail de simulation auquel on ne penserait pas initialement appliquer le calcul quantique, mais qui montre une réelle promesse. Ce n'est pas parfait, mais tu n'as pas besoin d'être un expert en physique des particules pour voir que l'ordinateur quantique prédit avec précision la propagation vers l'extérieur du paquet d'ondes, ce qui est exactement ce qu'on attendrait trouver. Espérons que les travaux futurs dans ce domaine se poursuivront et que les physiciens des hautes énergies continueront à trouver des moyens d'incorporer le calcul quantique dans leurs flux de travail.

Cas d'usage 2 : Optimisation d'un verre de spin d'Ising

Notre prochain exemple se concentre sur l'optimisation et sera une exploration approfondie d'un article intitulé Bias-Field Digitized Counterdiabatic Quantum Optimization, réalisé par des membres de l'équipe Kipu Quantum et de l'Université du Pays Basque en Espagne.

Dans l'article, les auteurs ont développé une nouvelle méthode d'optimisation et l'ont appliquée pour trouver l'état fondamental d'un verre de spin d'Ising. Comme nous l'avons discut�é précédemment, de nombreux problèmes d'optimisation combinatoire peuvent être reformulés comme la résolution pour les états à basse énergie des hamiltoniens d'Ising. Le modèle d'Ising décrit l'interaction d'un réseau de spins microscopiques. Dans certains régimes, le modèle prédit que les spins se comportent comme un verre, dans lequel les moments magnétiques sont désordonnés au-dessus d'une soi-disant « température de gel ».

Commençons comme avant avec une série de définitions. La première est contreadiabatique, qui est un type d'évolution qui supprime les effets non-adiabatiques subis par un système, quel que soit la rapidité de ces processus. Rappelons le théorème adiabatique du dernier épisode — il faut généralement faire évoluer un système très lentement si on souhaite qu'il reste dans l'état fondamental. C'est un gros problème car plus nous devons faire évoluer les choses lentement, plus nous avons de temps pour que des erreurs se produisent. Le pilotage contreadiabatique (CD) vise à combattre cela en ajoutant des termes qui contrecarrent ces excitations indésirables. L'idée principale ici est d'accélérer toute l'expérience et de réduire la profondeur du circuit quantique en supprimant les excitations qui pourraient provoquer des transitions parasites.

Passons maintenant à l'autre terme de jargon dans le titre : le champ de biais. D'autres algorithmes itératifs, comme VQE, prennent des paramètres classiques dans les états et utilisent des optimiseurs classiques pour explorer l'espace de paramètres multidimensionnel à la recherche de l'ensemble de paramètres qui donne une valeur d'espérance minimale pour un hamiltonien fixe. Dans ce cas, ils font plutôt varier le hamiltonien à chaque fois, se déplaçant adiabatiquement d'un cas connu au cas d'intérêt. Pour changer le hamiltonien, ils appliquent simplement directement la valeur d'espérance de Pauli-Z d'une itération comme champ de biais dans le hamiltonien pour l'itération suivante. De cette façon, ils orientent la dynamique vers la solution réelle sans avoir besoin d'optimiseurs classiques.

Pourquoi cette expérience est-elle d'intérêt ? Les verres de spin d'Ising sont d'un intérêt fondamental en physique, mais cette nouvelle approche est encore plus générale que cela. Elle pourrait être appliquée à de nombreux problèmes d'optimisation, donc l'article est d'un intérêt général.

Et pourquoi avions-nous pensé que cela fonctionnerait ? L'algorithme qu'ils proposent accélère l'évolution pour réduire la profondeur du circuit, tout en supprimant les transitions non-adiabatiques. De plus, il ne repose sur aucune sous-routine d'optimisation classique, ce qui peut être un problème conduisant à des plateaux stériles et à un blocage aux minima locaux. Enfin, les auteurs veillent également à aligner les interactions dans le hamiltonien du problème avec la connectivité du matériel dans les QPU réels, ce qui est toujours très important.

Comment cette méthode fonctionne-t-elle ? Encore une fois, elle n'utilise pas d'optimiseurs classiques, contrairement à la plupart des autres algorithmes quantiques itératifs. Au lieu de cela, en introduisant la solution de chaque itération comme entrée pour la suivante, l'algorithme d'optimisation quantique digitalisée à champ de biais affine incrémentalement l'état fondamental, le rapprochant de plus en plus de l'état évolué final. Et combiné avec les protocoles contreadiabatiques, nous pouvons faire cela même avec des circuits quantiques de faible profondeur qui devraient fonctionner correctement sur du matériel bruité.

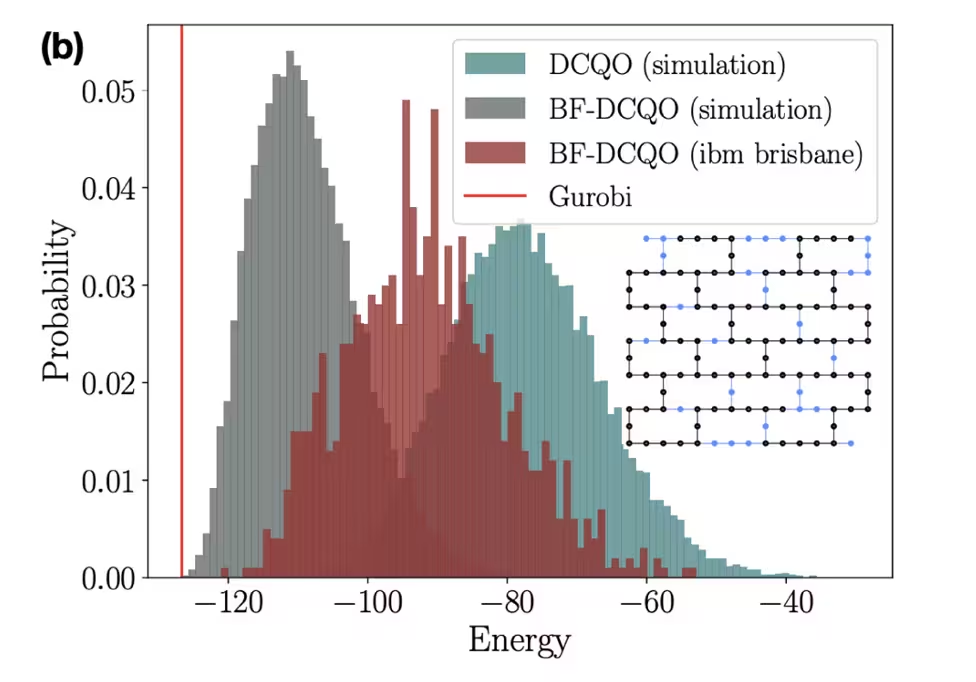

Ainsi, lors de l'expérience, les auteurs ont choisi d'exécuter l'algorithme sur l'ordinateur quantique IBM de 127 qubits Brisbane. Ci-dessous se trouve une figure montrant la 8ème itération de l'algorithme d'optimisation pour une instance de verre de spin générée aléatoirement à premiers voisins sur 100 qubits. Ils comparent les résultats de simulation classique idéalisés de DCQO et BF-DCQO, ainsi que le résultat expérimental exécuté sur l'ordinateur quantique. Ils montrent également le résultat d'un solveur classique appelé Gurobi comme référence. Avec seulement 10 itérations, BF-DCQO fournit une amélioration drastique par rapport à DCQO. Bien que le résultat expérimental soit légèrement différent du résultat idéal en raison du bruit, les performances sont toujours meilleures que le DCQO idéal. Cela montre qu'il y a encore beaucoup d'excellents progrès en matière d'optimisation quantique et de bons résultats sont rapportés sur plus de 100 qubits pour l'une des premières fois.

Cas d'usage 3 : Prédiction de la structure secondaire de l'ARNm

Enfin, nous discuterons d'un article de Moderna Pharmaceuticals intitulé mRNA Secondary Structure Prediction Using Utility-Scale Quantum Computers.

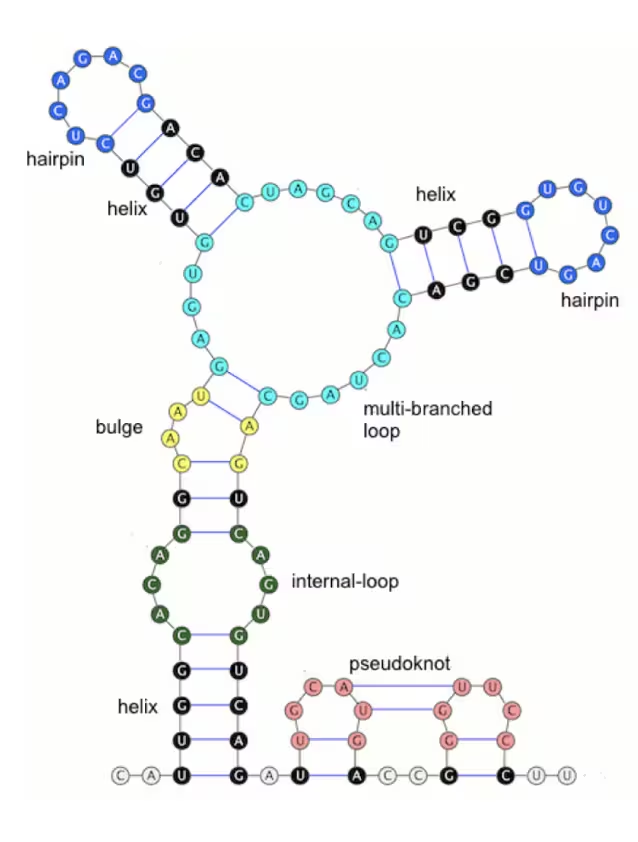

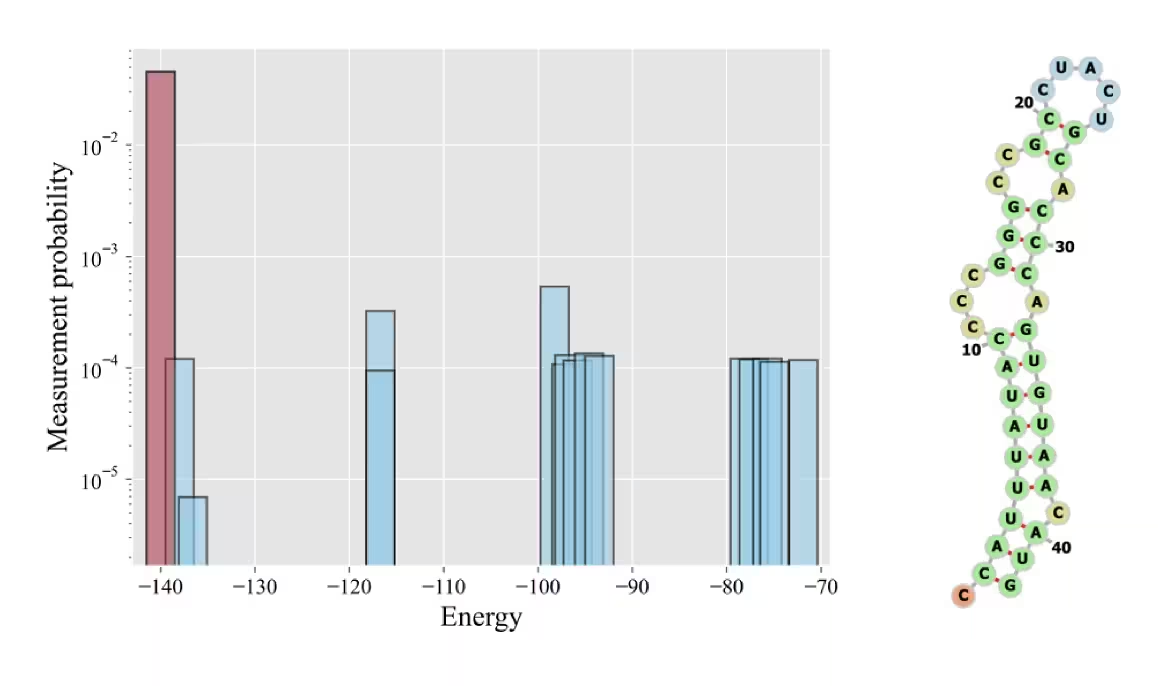

Premièrement, un bref rappel sur l'ARNm. L'ARN messager est un type d'ARN impliqué dans la synthèse des protéines. Il lit essentiellement les instructions données par l'ADN. La structure secondaire de l'ARNm est la façon dont la chaîne est repliée, comme le montre le diagramme ci-dessous. Et le problème de prédiction de la structure secondaire de l'ARN est le problème de trouver le repliement le plus stable de la séquence de bases ou nucléotides qui composent l'ARN : l'adénine (A), la cytosine (C), l'uracile (U) et la guanine (G). L'image ci-dessous montre quelques structures de repliement courantes trouvées dans l'ARNm, chaque couleur représente un type différent de structure secondaire. Ce qui rend une structure plus favorable que les autres n'est pas bien compris ; tout ce qu'on peut faire est de calculer quelle structure donne l'énergie libre la plus basse par rapport à l'état déplié. Et c'est là qu'interviennent les ordinateurs quantiques.

Pourquoi les structures secondaires de l'ARNm sont-elles importantes ? Leur prédiction précise est cruciale non seulement pour comprendre l'ADN et nos gènes, mais aussi pour concevoir des thérapeutiques à base d'ARN, comme le vaccin contre la COVID-19.

Il est depuis longtemps reconnu que c'est un problème d'optimisation formidable pour les ordinateurs classiques en raison du vaste nombre de configurations possibles. Pour certaines configurations, il est connu qu'il s'agit d'un problème NP-complet. Cependant, sur un ordinateur quantique, nous pouvons formuler la prédiction de la structure secondaire comme un problème d'optimisation binaire — quelque chose que nous savons comment gérer. De plus, il y avait déjà des preuves dans la littérature de prédictions précises d'ARN sur de petits dispositifs quantiques et des simulateurs quantiques. Mais cela fonctionnerait-il sur du matériel plus grand ?

Cette expérience a été réalisée en utilisant ce qu'on appelle le solveur propre quantique variationnel à valeur conditionnelle à risque, qui est une modification d'un algorithme VQE traditionnel et est censé atteindre une meilleure convergence.

Le graphique ci-dessus montre la distribution des probabilités de mesure des chaînes de bits échantillonnées, avec les énergies correspondantes pour une instance de 42 nucléotides et 80 qubits. Ici, les chaînes de bits symbolisent des appariements de nucléotides. Il illustre que la chaîne de bits d'énergie la plus basse trouvée par l'ordinateur quantique correspond à celle du solveur classique comparatif, ce qui est excellent. On montre également la structure repliée optimale de cette chaîne de nucléotides basée sur la chaîne de bits d'énergie la plus basse que l'ordinateur quantique a trouvée.

Conclusion

Espérons que ces trois cas d'usage t'ont donné suffisamment de contexte pour comprendre à quoi ressemble le travail de pointe dans le domaine en ce moment, et la confiance pour tenter de nouvelles expériences quantiques que tu n'aurais peut-être pas osé avant.

N'oublie pas : le calcul quantique n'est pas bon pour tous les problèmes. Et c'est vraiment un témoignage de combien nous sommes devenus bons en calcul classique. Le simple fait que tu penses pouvoir appliquer le calcul quantique à un problème ne signifie pas que cela donnera des résultats intéressants ; tu dois considérer la mise à l'échelle.

La profondeur du circuit est une arme à double tranchant. Nous avons besoin qu'elle soit considérablement grande pour faire des travaux intéressants que les ordinateurs classiques ne peuvent pas faire, mais en ce moment, nous ne pouvons pas augmenter trop la profondeur car le bruit du matériel fera diminuer la fidélité. Tout est question de trouver ce point idéal et de savoir que c'est une cible mouvante. Alors, prends le temps entre maintenant et la prochaine leçon pour réfléchir à un problème que tu as rencontré dans ta recherche, et à la façon dont tu pourrais l'aborder avec ce que nous avons appris jusqu'à présent. Et qui sait, ta solution pourrait ne pas aboutir, et c'est bien. C'est pour ça que c'est de la recherche.